Categorías

Resumen

Simulador de reconocimiento de actividad humana que utiliza aprendizaje federado con inferencia en el dispositivo e inferencia de aprendizaje profundo en el servidor. Incluye una aplicación para Android y una API Flask para comparar los enfoques FL y DL.

Acerca del proyecto

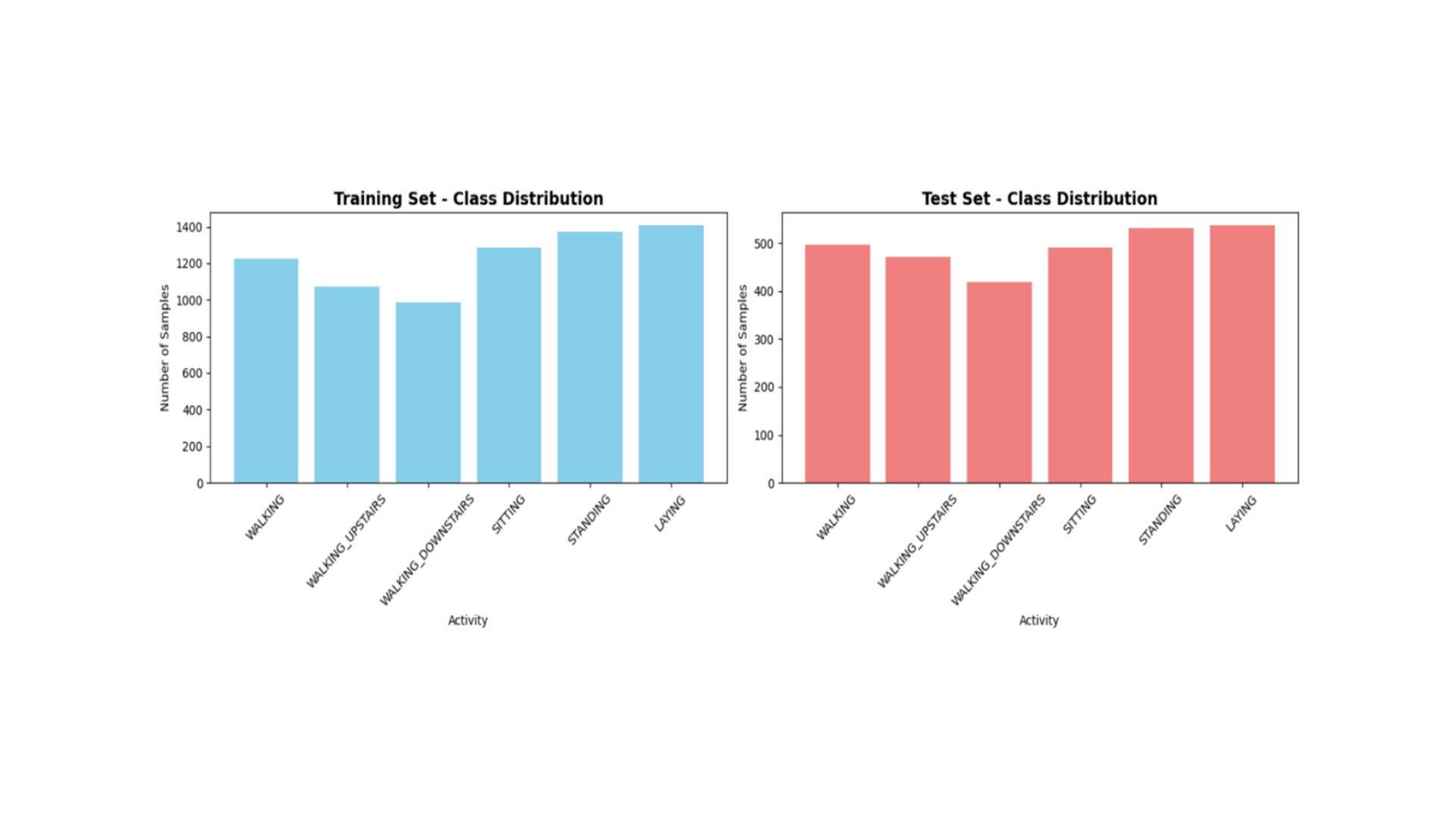

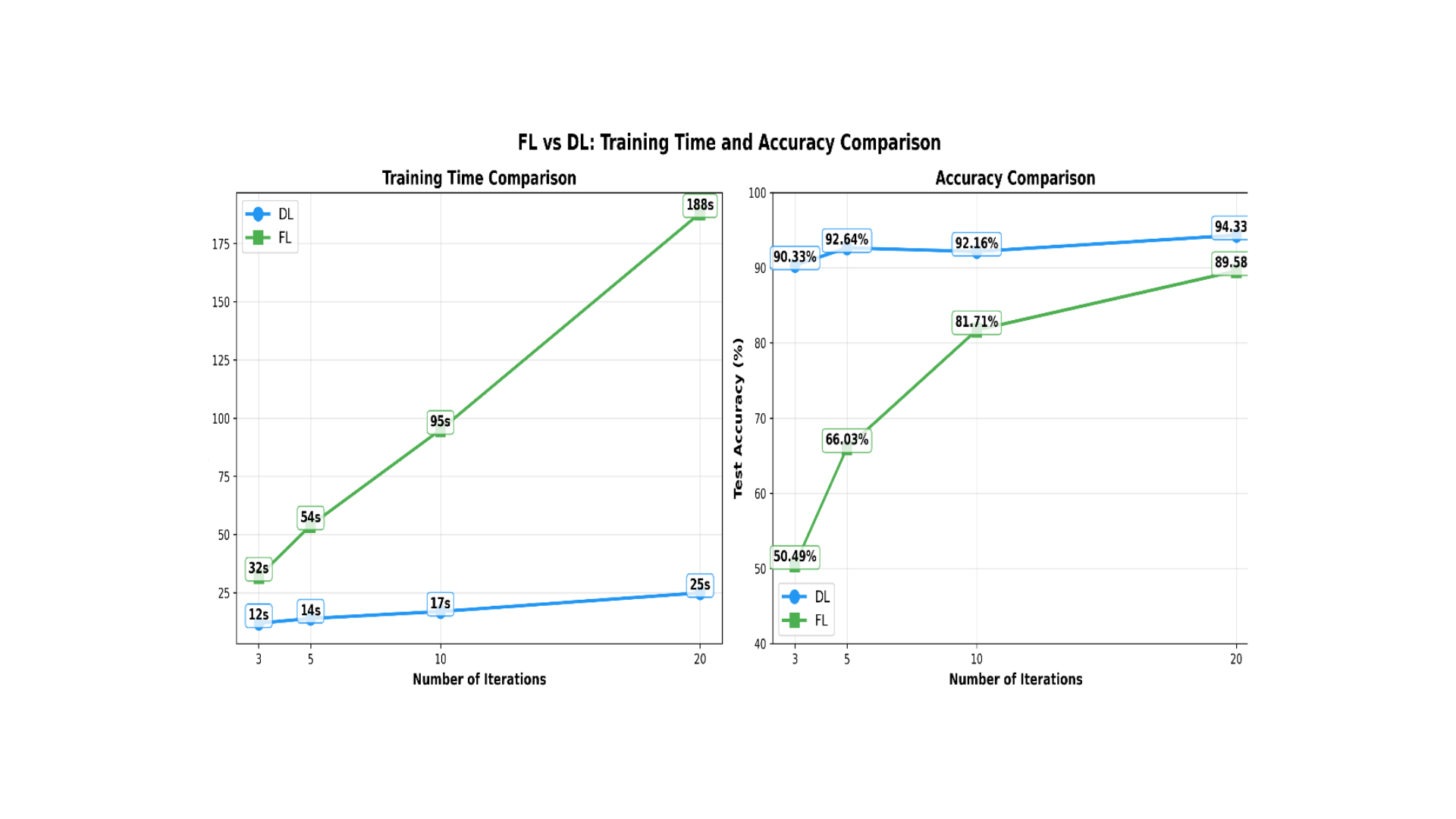

Este proyecto de tesis presenta un sistema integral de reconocimiento de actividades humanas (HAR) basado en dos paradigmas de aprendizaje automático: el aprendizaje profundo centralizado y el aprendizaje federado con preservación de la privacidad, evaluados comparativamente en el conjunto de datos HAR de la UCI (561 características, 6 clases de actividades, 10 299 muestras). La capa de entrenamiento del modelo implementa ambas arquitecturas utilizando TensorFlow/Keras y PyTorch, lo que da como resultado modelos entrenados con parámetros de referencia de rendimiento en cuanto a precisión, exactitud, recuperación y puntuación F1. La API REST de Flask expone 17 puntos finales organizados según los principios SOA: controladores de ruta (Blueprints), componentes de servicio dedicados (DeepLearningService, FederatedService, GradientAggregator) y utilidades compartidas para el preprocesamiento, la validación y el seguimiento de métricas. La aplicación móvil para Android, creada con Kotlin y Jetpack Compose (MVVM), recopila datos de sensores inerciales en tiempo real, realiza inferencias FL en el dispositivo a través de PyTorch Mobile y se comunica con la API a través de Retrofit. Los usuarios pueden activar predicciones, enviar comentarios para actualizar el modelo federado y revisar el historial de clasificación.

Enlaces

Fecha de creación

diciembre 13, 2025