Kategorien

Zusammenfassung

Simulator zur Erkennung menschlicher Aktivitäten unter Verwendung von föderiertem Lernen mit geräteinterner Inferenz und serverseitiger Deep-Learning-Inferenz. Enthält eine Android-App und eine Flask-API zum Vergleich von FL- und DL-Ansätzen.

Über das Projekt

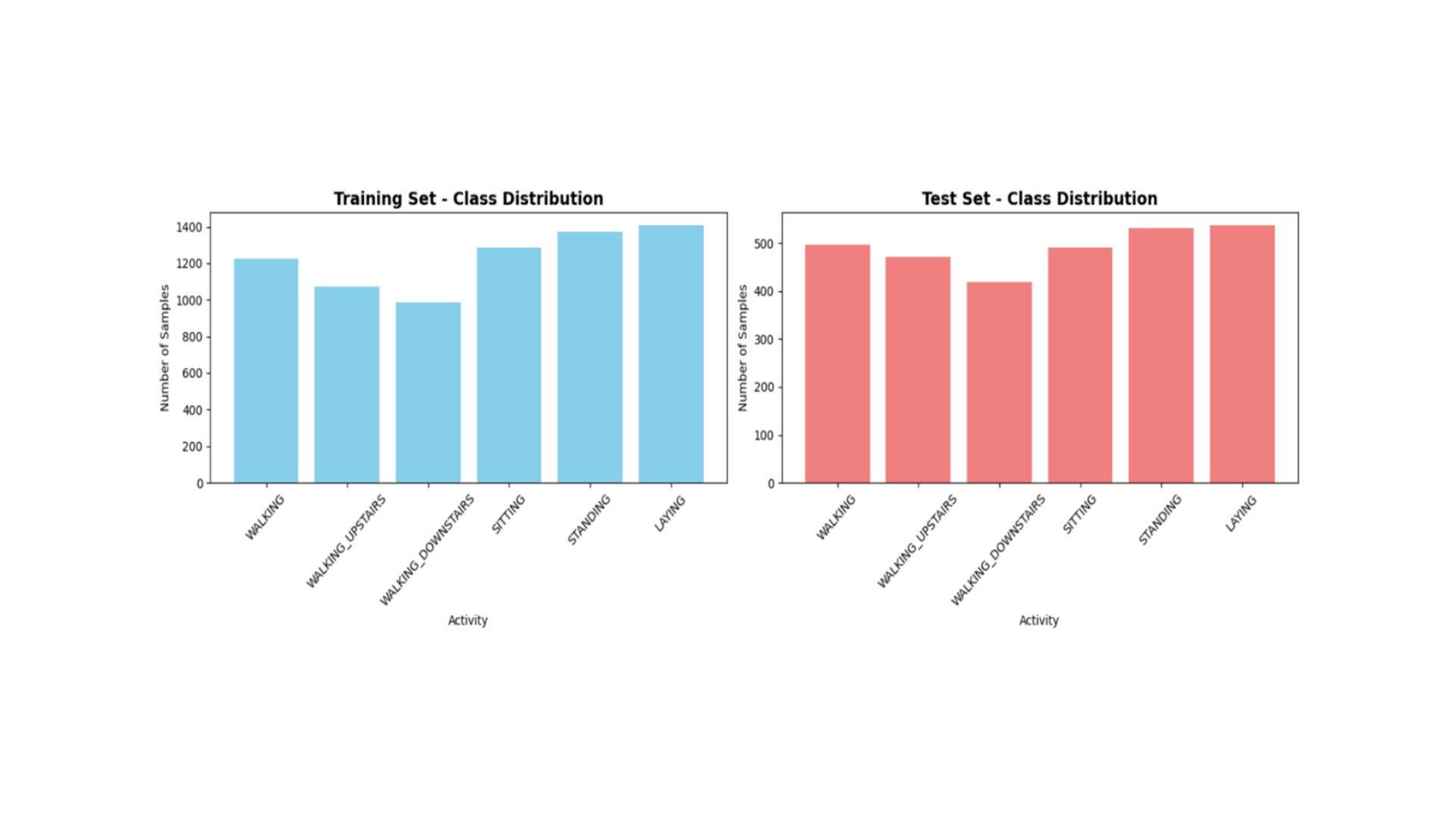

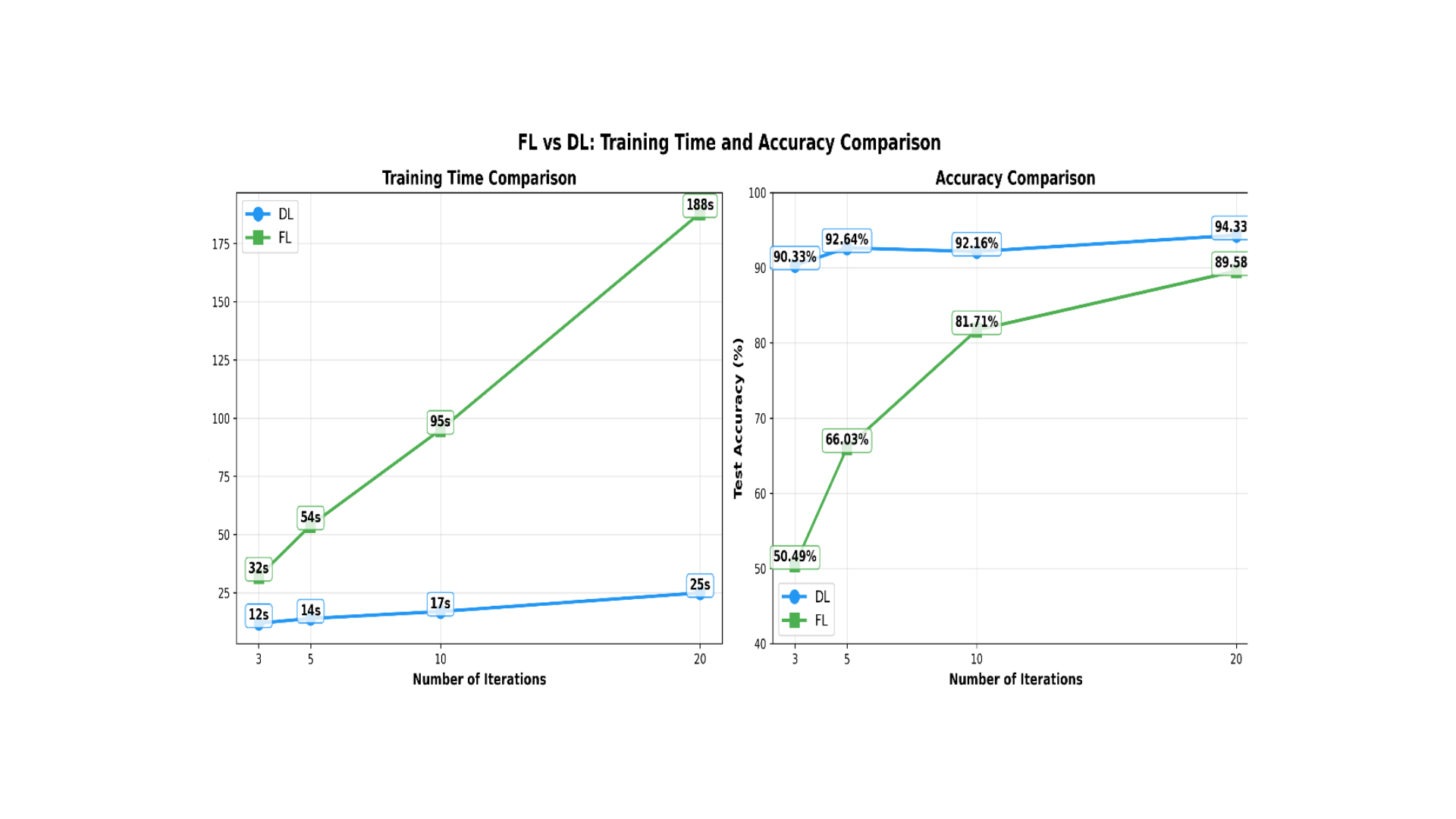

Dieses Abschlussprojekt liefert ein End-to-End-System zur Erkennung menschlicher Aktivitäten (Human Activity Recognition, HAR), das auf zwei Paradigmen des maschinellen Lernens basiert – zentralisiertes Deep Learning und datenschutzkonformes föderiertes Lernen (Federated Learning) – und anhand des UCI HAR-Datensatzes (561 Merkmale, 6 Aktivitätsklassen, 10.299 Stichproben) vergleichend bewertet wurde. Die Modelltrainingsschicht implementiert beide Architekturen unter Verwendung von TensorFlow/Keras und PyTorch und erzeugt trainierte Modelle mit Leistungsbenchmarks für Genauigkeit, Präzision, Recall und F1-Score-Metriken. Die Flask-REST-API stellt 17 Endpunkte bereit, die nach SOA-Prinzipien organisiert sind: Routen-Controller (Blueprints), dedizierte Servicekomponenten (DeepLearningService, FederatedService, GradientAggregator) und gemeinsam genutzte Dienstprogramme für die Vorverarbeitung, Validierung und Metrikverfolgung. Die mit Kotlin und Jetpack Compose (MVVM) entwickelte Android-Mobil-App sammelt Echtzeit-Inertialsensordaten, führt über PyTorch Mobile eine FL-Inferenz auf dem Gerät durch und kommuniziert über Retrofit mit der API. Benutzer können Vorhersagen auslösen, Feedback zur Aktualisierung des föderierten Modells übermitteln und den Klassifizierungsverlauf überprüfen.

Links

Erstellungsdatum

Dezember 13, 2025